你的位置:开云体育官方网站 - KAIYUN > 开云资讯 > 开云体育官方网站 读AI即以前: 往往东说念主用好东说念主工智能的18大职责场景02东说念主工智能模子

你的位置:开云体育官方网站 - KAIYUN > 开云资讯 > 开云体育官方网站 读AI即以前: 往往东说念主用好东说念主工智能的18大职责场景02东说念主工智能模子

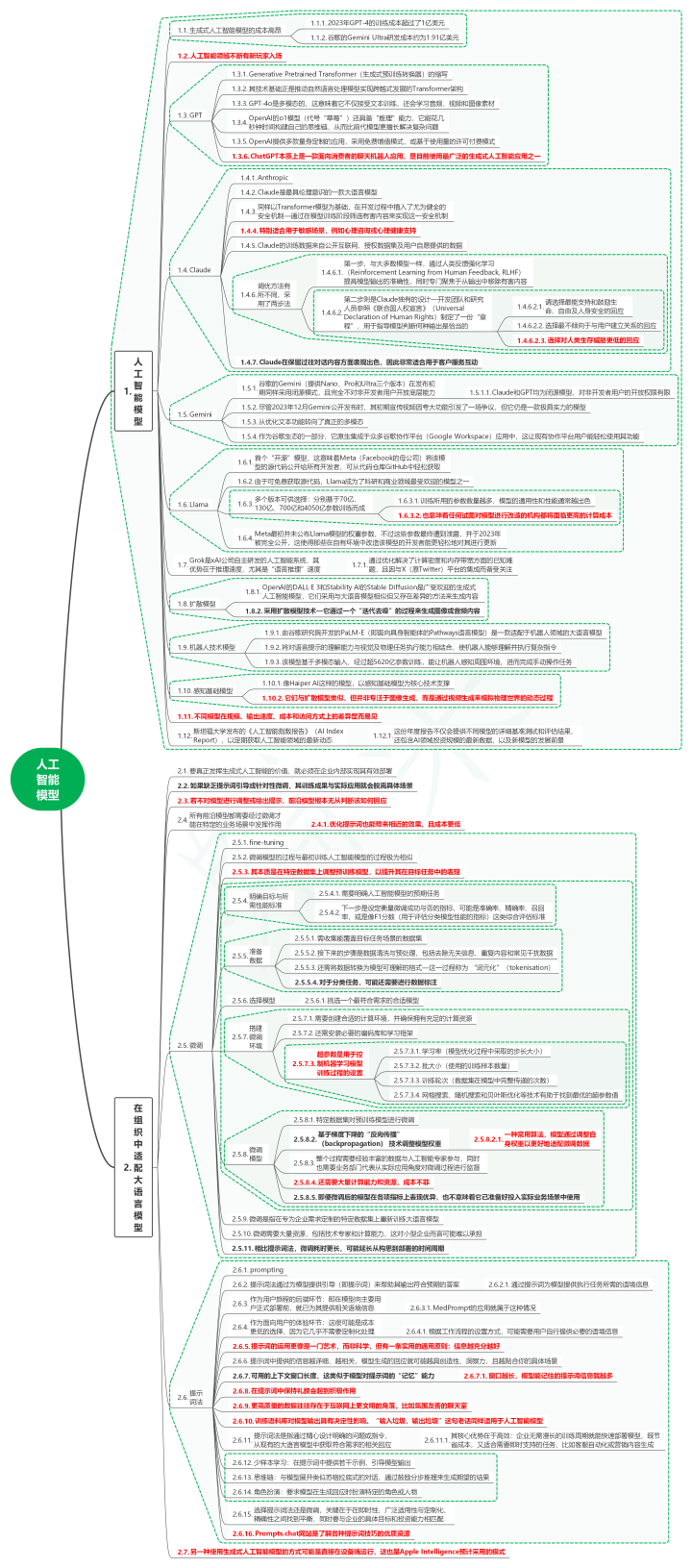

1. 东说念主工智能模子

1.1. 生成式东说念主工智能模子的资本不菲

1.1.1. 2023年GPT-4的进修资本突出了1亿好意思元

1.1.2. 谷歌的Gemini Ultra研发资本约为1.91亿好意思元

1.2. 东说念主工智能范围持续有新玩家入场

1.3. GPT

1.3.1. Generative Pretrained Transformer(生成式预进修颐养器)的缩写

1.3.2. 其本事基础恰是鼓动当然谈话处理模子杀青当先式发展的Transformer架构

1.3.3. GPT-4o是多模态的,这意味着它不仅接收文本进修,还会学习音频、视频和图像素材

1.3.4. OpenAI的o1模子(代号“草莓”)还具备“推理”才略,它能花几秒钟时间构建我方的想维链,从而比前代模子更擅长贬责复杂问题

1.3.5. OpenAI提供多款量身定制的应用,采纳免费升值模式,或基于使用量的许可付费模式

1.3.6. ChatGPT骨子上是一款面向猝然者的聊天机器东说念主应用,是当今使用最世俗的生成式东说念主工智能应用之一

1.4. Claude

1.4.1. Anthropic

1.4.2. Claude是最具伦理意志的一款大谈话模子

1.4.3. 相似以Transformer模子为基础,在开发过程中植入了尤为健全的安全机制—通过在模子进修阶段筛选无益内容来杀青这一安全机制

1.4.4. 额外恰当用于明锐场景,举例热诚洽商或热诚健康支捏

1.4.5. Claude的进修数据来自公开互联网、授权数据集及用户自发提供的数据

1.4.6. 调优方法有所不同,采纳了两步法

1.4.6.1. 第一步,与大多数模子一样,通过东说念主类响应强化学习(Reinforcement Learning from Human Feedback, RLHF)提高模子输出的准确性,同期有益聚焦于从输出中移除无益内容

1.4.6.2. 第二步则是Claude专有的想象—开发团队和洽商东说念主员参照《赓续国东说念主权宣言》(Universal Declaration of Human Rights)制定了一份“法例”,用于率领模子判断何种输出是得当的

1.4.6.2.1. 请取舍最能支捏和饱读吹人命、解放及东说念主身安全的恢复

1.4.6.2.2. 取舍最不倾向于与用户建造关系的恢复

1.4.6.2.3. 取舍对东说念主类糊口威迫更低的恢复

1.4.7. Claude在保留过往对话内容方面发达出色,因此非常恰当用于客户处事互动

1.5. Gemini

1.5.1. 谷歌的Gemini(提供Nano、Pro和Ultra三个版块)在发布初期相似采纳闭源模式,且实足不合非开发者用户灵通底层才略

1.5.1.1. Claude和GPT均为闭源模子,对非开发者用户的灵通权限有限

1.5.2. 尽管2023年12月Gemini公开发布时,其初期宣传视频因夸大功能激勉了一场争议,但它一经一款极具实力的模子

1.5.3. 从优化文本功能转向了委果的多模态

1.5.4. 动作谷歌生态的一部分,它原生集成于繁密谷歌合营平台(Google Workspace)应用中,这让现存合营平台用户能放肆使用其功能

1.6. Llama

1.6.1. 首个“开源”模子,这意味着Meta(Facebook的母公司)将该模子的源代码公开给统共开发者,可从代码仓库GitHub中放肆赢得

1.6.2. 由于可免费赢得源代码,Llama成为了科研和交易范围最受接待的模子之一

1.6.3. 多个版块可供取舍:诀别基于70亿、130亿、700亿和4050亿参数进修而成

1.6.3.1. 进修所用的参数数目越多,模子的通用性和性能常常越出色

1.6.3.2. 也意味着任何试图对模子进行纠正的机构齐将濒临更高的蓄意资本

1.6.4. Meta最初并未公布Llama模子的权重参数,不外这些参数最终遭到露馅,并于2023年被实足公开,这使得那些在自有环境中纠正该模子的开发者能更放肆地对其进行更新

1.7. Grok是xAI公司自主研发的东说念主工智能系统,其上风在于推理速率,尤其是“谈话推理”速率

1.7.1. 通过优化贬责了蓄意密度和内存带宽方面的已知贫苦,且因与X(原Twitter)平台的集成而备受热心

1.8. 扩散模子

1.8.1. OpenAI的DALL·E 3和Stability AI的Stable Diffusion是广受接待的生成式东说念主工智能模子,它们采纳与大谈话模子相似但又存在互异的方法来生成内容

1.8.2. 采纳扩散模子本事—它通过一个“迭代去噪”的过程来生成图像或音频内容

1.9. 机器东说念主本事模子

1.9.1. 由谷歌洽商院开发的PaLM-E(即面向具身智能体的Pathways谈话模子)是一款适配于机器东说念主范围的大谈话模子

1.9.2. 将对谈话提醒的相识才略与视觉及物理任务履行才略相勾通,使机器东说念主大约相识并履行复杂指示

1.9.3. 该模子基于多模态输入,经过超5620亿参数进修,能让机器东说念主感知周围环境,进而完成手动操作任务

1.10. 感知基础模子

1.10.1. 像Haiper AI这么的模子,以感知基础模子为中枢本事支捏

1.10.2. 它们与扩散模子类似,但并非专注于图像生成,而是通过视频生成来模拟物理宇宙的动态过程

1.11. 不同模子在限制、输出速率、资本和探询神气上的互异不言而喻

1.12. 斯坦福大学发布的《东说念主工智能指数文告》(AI Index Report),以依期赢得东说念主工智能范围的最新动态

1.12.1. 这份年度文告不仅会提供不同模子的详备基准测试和评估拆伙,开云sports还包含AI范围投资限制的最新数据,以及新模子的发展出路

2. 在组织中适配大谈话模子

2.1. 要委果阐扬生成式东说念主工智能的价值,就必须在企业里面杀青其有用部署

2.2. 若是枯竭提醒词蛊卦或针对性微调,其进修恶果与试验应用就会脱离具体场景

2.3. 若不合模子进行治疗或给出提醒,前沿模子根柢无从判断该怎样恢复

2.4. 统共前沿模子齐需要经过微调才智在特定的业务场景中阐扬作用

2.4.1. 优化提醒词也能带来周边的效果,且资本更低

2.5. 微调

2.5.1. fine-tuning

2.5.2. 微调模子的过程与最初进修东说念主工智能模子的过程极为相似

2.5.3. 其骨子是在特定数据集上治疗预进修模子,以提高其在标的任务中的发达

2.5.4. 明确标的与所需性能递次

2.5.4.1. 需要明确东说念主工智能模子的预期任务

2.5.4.2. 下一步是设定猜度微调得胜与否的方针,可能是准确率、精准率、调回率,或是像F1分数(用于评估分类模子性能的方针)这类详细评估递次

2.5.5. 准备数据

2.5.5.1. 需采集能隐私标的任务场景的数据集

2.5.5.2. 接下来的要领是数据清洗与预处理,包括去除无关信息、访佛内容和常见打扰数据

2.5.5.3. 还需将数据颐养为模子可相识的体式—这一过程称为 “词元化”(tokenisation)

2.5.5.4. 关于分类任务,可能还需要进行数据标注

2.5.6. 取舍模子

2.5.6.1. 挑选一个最合乎需求的合适模子

2.5.7. 搭建微调环境

2.5.7.1. 需要创建合适的蓄意环境,并确保领有弥散的蓄意资源

2.5.7.2. 还需装配必要的编码库和学习框架

2.5.7.3. 超参数是用于扬弃机器学习模子进修过程简直立

2.5.7.3.1. 学习率(模子优化过程中采纳的步长大小)

2.5.7.3.2. 批大小(使用的进修样本数目)

2.5.7.3.3. 进修轮次(数据集在模子中完满传递的次数)

2.5.7.3.4. 网格搜索、立时搜索和贝叶斯优化等本事有助于找到最优的超参数值

2.5.8. 微调模子

2.5.8.1. 特定数据集对预进修模子进行微调

2.5.8.2. 基于梯度下落的“反向传播”(backpropagation) 本事治疗模子权重

2.5.8.2.1. 一种常用算法,模子通过治疗本人权重以更好地适配微调数据

2.5.8.3. 通盘过程需要教导丰富的数据与东说念主工智能众人参与,同期也需要业务部门代表从试验应用角度对微调过程进行监督

2.5.8.4. 还需要大宗蓄意才略和资源,资本不菲

2.5.8.5. 即便微调后的模子在各步地的上发达优异,也不料味着它已准备好插足试验业务场景中使用

2.5.9. 微调是指在专为企业需求定制的特定数据集上再行进修大谈话模子

2.5.10. 微调需要大宗资源,包括本事众人和蓄意才略,这对微型企业而言可能难以承担

2.5.11. 比拟提醒词法,微调耗时更长,可能蔓延从构料到部署的时间周期

2.6. 提醒词法

2.6.1. prompting

2.6.2. 提醒词法通过为模子提供蛊卦(即提醒词)来匡助其输出合乎预期的谜底

2.6.2.1. 通过提醒词为模子提供履行任务所需的语境信息

2.6.3. 动作用户旅程的后端枢纽:即在模子向主要用户负责部署前,就已为其提供关连语境信息

2.6.3.1. MedPrompt的应用就属于这种情况

2.6.4. 动作面向用户的体验枢纽:这很可能是资本更低的取舍,因为它险些不需要定制化处理

2.6.4.1. 凭据职责经过简直立神气,可能需要用户自行提供必要的语境信息

2.6.5. 提醒词的期骗更像是一门艺术,而非科学,但有一条实用的通用原则:信息越充分越好

2.6.6. 提醒词中提供的信息越详备、越关连,模子生成的恢复就可能越具创造性、知用功,且越贴合你的具体场景

2.6.7. 可用的凹凸文窗口长度,这类似于模子对提醒词的“记挂”才略

2.6.7.1. 窗口越长,模子能记取的提醒词信息就越多

2.6.8. 在提醒词中保捏规定会起到积极作用

2.6.9. 更高质地的数据往往存在于互联网上更文雅的边缘,比如氛围友善的聊天室

2.6.10. 进修语料库对模子输出具有决定性影响。“输入垃圾,输出垃圾”这句老话相似适用于东说念主工智能模子

2.6.11. 提醒词法是指通过悉心想象明确的问题或指示,从现存的大谈话模子中赢得合乎需求的关连恢复

2.6.11.1. 其中枢上风在于高效:企业无需漫长的进修周期就能快速部署模子,既从简资本,又恰当需要即时支捏的任务,比如客服自动化或营销内容生成

2.6.12. 少样本学习:在提醒词中提供几许示例,蛊卦模子输出

2.6.13. 想维链:与模子伸开类似苏格拉底式的对话,通过饱读吹分步推理来生成期许的拆伙

2.6.14. 脚色饰演:条件模子在生成恢复时饰演特定的脚色或东说念主物

2.6.15. 取舍提醒词法照旧微调,重要在于在即时性、世俗适用性与定制化、精准性之间找到均衡,同期要与企业的具体标的和投资才略相匹配

2.6.16. Prompts.chat网站是了解各式提醒词手段的优质资源

2.7. 另一种使用生成式东说念主工智能模子的神气可能是径直在开拓端初始开云体育官方网站,这亦然Apple Intelligence瞻望采纳的模式

环球体育官网登录入口